[뉴스비전e 장연우 기자] 최근 구글 리서치 그룹은 논문을 통해 이미지 인식 AI의 알고리즘을 오작동시킬 수 있는 스티커를 발표했다.

논문에 따르면 ‘애드버세리얼 패치(Adversarial Patch, 적대적 스티커)’라 불리우는, 추상화를 연상시키는 디자인의 원형 스티커를 사물 옆에 붙여 두면 이미지 인식 알고리즘이 제대로 작동하지 않게 된다.

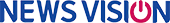

논문에 소개된 실험결과에 따르면 바나나가 놓여 있는 테이블에 스티커를 붙이면 97%의 확률로 바나나로 인식하던 AI가 99%의 확률로 토스터로 인식하는 것으로 나타났다.

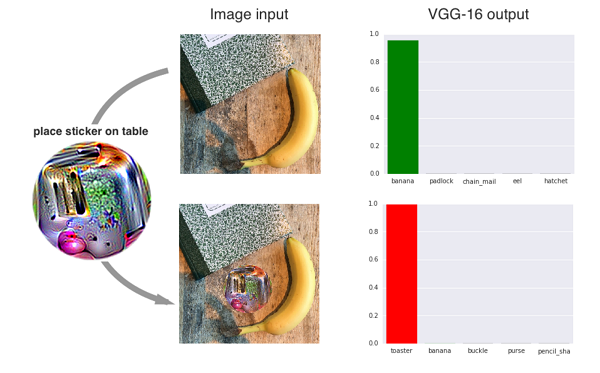

놀라운 점은 실물 바나나 옆에 토스터 기기가 인쇄된 스티커를 붙인 경우에도 거의 100%의 확률로 바나나를 인식하던 AI가 애드버세리얼 패치를 붙이자 거의 100% 확률로 토스터 기기라고 인식했다는 점이다.

토스터 스티커를 붙인 경우 후보군에 토스터 기기가 제시되기는 하지만 그 확률은 1% 내외로 오인식 가능성이 없지만, 애드버세리얼 패치를 붙인 경우 바나나로 인식할 확률 역시 1% 내외에 불과해 무조건 오인식이 된다는 것을 보여 준다.

애드버세리얼 패치의 등장에 주목해야 하는 이유는, 먼저 이 스티커가 인터넷을 통해 공유되면 기술에 대한 지식이 없는 사람도 누구나 다운받아 인쇄한 후 사용할 수 있기 때문이다.

또한, 이미지 인식 기능의 근간인 신경망을 쉽게 속일 수 있다는 문제 제기는 그 동안 많았지만, 구글의 스티커는 실생활에서 손쉽게 피해를 야기할 수 있다는 점에서 매우 심각하다.

많은 논문에서 이미지 인식 알고리즘을 속이는 수법이나 네트워크의 취약점을 지적했고, 구글이 공개한 이번 논문도 그 중 하나지만, 지금까지 논의와 크게 다른 점은 이 스티커를 인쇄해 붙이는 것만으로도 AI의 오작동을 일으켜 사회에 문제를 일으킬 수 있다는 것이다.

애드버세리얼 패치는 마치 추상화 같아서 사람의 눈으로는 특정 개체가 그려져 있다고 인식 할 수 없기 때문에, 만일 누군가 이미지 인식 오작동을 목적으로 붙여 놓을 경우 아무도 오작동의 위험성이 있다고 느낄 수 없으나 실제로는 큰 위험을 야기하게 된다.

정보통신기술진흥센터(IITP)는 주간기술동향 보고서에서 "애드버세리얼 패치(Adversarial Patch, 적대적 스티커)는 AI 교란을 통한 공격이 늘어날 수 있음을 시사한다"며, "AI를 통한 안전성 제고만큼이나 AI를 악용한 안전성 위협 우려가 높아지는 데에 대한 대비가 필요하다"고 강조했다.

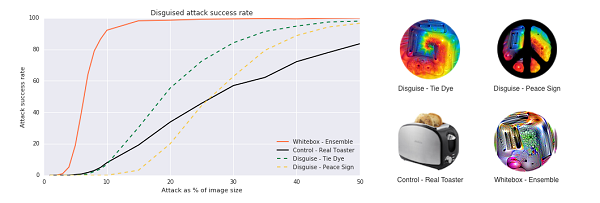

예상해 볼 수 있는 위험 중 하나가 자율주행차의 운행을 방해하는 것이다.

애드버세리얼 패치만 붙여 놓아도 자율주행차는 그 도로 교통표지판을 제대로 인식할 수 없게 되기 때문이다.

자율주행차는 카메라로 포착한 이미지를 이미지 인식 알고리즘으로 분석해 차량 주변의 개체를 파악하는데, 만약 도로 교통 표지판에 애드버세리얼 패치를 부착하면 자동차는 이를 토스터 기기로 잘못 인식할 수 있다.

테슬라의 자율주행 지원 기능인 ‘오토파일럿(Autopilot)’은 도로 표지판을 읽어 속도 제한 여부를 파악하는데, 이 스티커가 부착되면 오토파일럿의 기능에 장애가 초래되며, 당연히 표지판에 스티커를 붙이는 것은 중대 범죄 행위로 처벌 대상이 될 수 있다.

2017년 7월 워싱턴 대학의 한 연구팀은 교통 표지판에 정교하게 만든 스티커를 붙여 넣으면 이미지 인식 알고리즘이 ‘정지’ 표지판을 ‘속도 제한’ 표지판으로 오인식 한다고 발표한 바 있으며, 구글의 스티커는 이 보다 훨씬 더 간단한 오작동 유도가 가능하다.

이처럼 이미지 인식 알고리즘이 인식하는 데이터(example)에 노이즈를 추가해 오류를 일으키는 공격 기법을 “애드버세리얼 이그잼플(Adversarial Example, 적대적 사례)”이라 하며, 구글의 스티커는 이 공격을 누구나 쉽게 할 수 있는 환경이 되었음을 의미한다.

구글이 애드버세리얼 패치에 대한 논문을 공개한 이유는 AI를 이용한 공격의 위험성을 경고하고, 이에 대한 방어를 위해 이미지 인식 알고리즘의 개선을 촉구하기 위해서다.

특히 구글이 구글이 우려하는 것은 이미지 인식 클라우드 서비스가 아니라 네트워크나 컴퓨팅 자원 이용의 제약으로 인해 디바이스 내에서 이미지 인식 알고리즘이 실행되는 경우다.

이미지 인식 클라우드 서비스들은 대부분 고급 알고리즘을 도입하고 있는데, 가령 구글의 ‘클라우드 비전(Cloud Vision)’ 이미지 인식 서비스에 스티커를 붙인 사진을 입력해도 오작동이 일어나지 않고 사진의 객체를 제대로 인식하는 것으로 알려졌다.

그러나 농장 작업에 쓰이는 자율주행 트랙터나 공사 현장에서 자동으로 작업을 하는 불도저에 탑재된 이미지 인식 알고리즘은 클라우드가 아니라 차량이나 장치 내에서 실행되며, 이러한 엣지(edge, 최종 단말기)에서는 대규모 연산 환경 제공이 어려운 한계가 있다.

이런 경우 오작동 가능성이 높아 실시간으로 정확한 객체 판정을 할 수 있는 이미지 인식 알고리즘과 이를 지원할 고급 AI 전용 프로세서의 개발이 필요하다는 것이 구글의 제안이다.

일상생활 속에서 드론, 로봇, 자율주행차 등의 이용이 확산될 경우 AI 를 악용한 공격은 현실적 문제로 대두될 것이기 때문에 이를 방어하기 위한 대책 강구, 특히 이미지 인식 알고리즘의 정확도를 개선하는 것이 아주 중요한 과제가 된다는 것이다.

정보기술진흥센터 관계자는 "이제는 보안업체뿐 아니라 해커들도 AI를 이용하기 때문에 이미지 알고리즘 정확도 개선 노력이 요구된다"며, "애드버세리얼 패치 기술도 계속 고도화될 것이기 때문에 향후 AI를 이용한 공격과 방어 수단 개발의 치열한 전투가 본격적으로 시작될 것"이라고 전망했다.